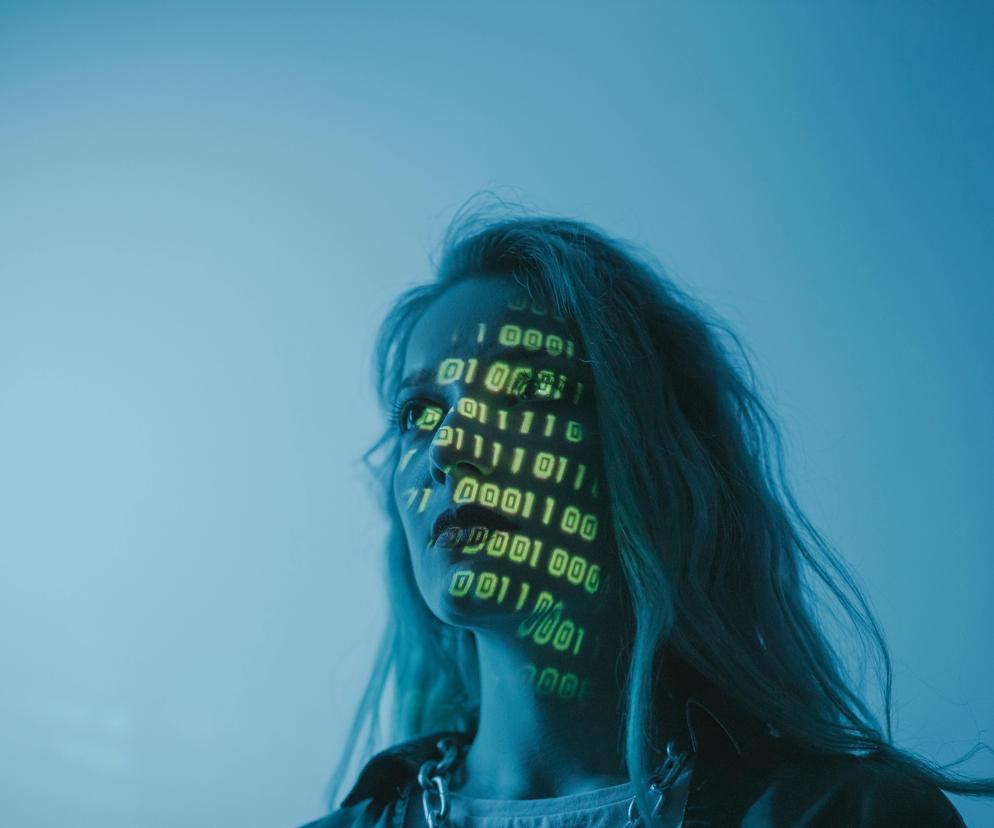

Moralność sztucznej inteligencji wyższa od moralności człowieka? Eksperci dokładnie to zbadali

Badanie „Atrybucje sztucznych czynników w zmodyfikowanym teście Turinga” (https://www.nature.com/articles/s41598-024-58087-7) zostało przeprowadzone przez zespół prof. Eyala Aharoniego z Georgia State University (USA). Inspiracją dla naukowców był niezwykły rozkwit sztucznej inteligencji - dużych modeli językowych (LLM), takich jak ChatGPT, które zaczęły zyskiwać na znaczeniu w marcu ubiegłego roku.

-Byłem już zainteresowany podejmowaniem decyzji moralnych w systemie prawnym, ale zastanawiałem się, czy ChatGPT i inne LLM mogłyby mieć coś do powiedzenia na ten temat – powiedział Aharoni. - Ludzie będą wchodzić w interakcję z tymi narzędziami w sposób, który będzie miał implikacje moralne, na przykład konsekwencje dla środowiska, jeśli poprosimy o listę rekomendacji dotyczących nowego samochodu. Niektórzy prawnicy zaczęli już konsultować się z tymi technologiami w prowadzonych przez siebie sprawach. Jeśli więc chcemy korzystać z tych narzędzi, powinniśmy zrozumieć, jak działają, jakie mają ograniczenia i że niekoniecznie działają w sposób, w jaki myślimy, kiedy z nimi współpracujemy.

Aby sprawdzić, jak sztuczna inteligencja radzi sobie z kwestiami moralnymi, Aharoni zaprojektował specyficzną formę testu Turinga.

Alan Turing, jeden z twórców komputera, przewidział, że do roku 2000 komputery mogą przejść test, podczas którego zwykłemu człowiekowi zaprezentowane zostaną dwie interakcje, jedna z osobą, a druga z komputerem, ale w obu przypadkach jedynym sposobem komunikowania się będzie tekst. Wtedy człowiek może zadawać dowolne pytania, aby uzyskać informacje potrzebne do podjęcia decyzji, który z dwóch elementów interakcji jest człowiekiem, a który komputerem – zaznaczył Aharoni. - Jeśli człowiek nie potrafi ich rozróżnić, to - zdaniem Turinga - komputer należy nazwać inteligentnym.

Polecany artykuł:

Moralność sztucznej inteligencji. Wyniki badania zaskakują

Na potrzeby testu Turinga Aharoni zadał studentom studiów licencjackich i sztucznej inteligencji te same pytania etyczne, a następnie przedstawił uczestnikom badania pisemne odpowiedzi. Następnie poproszono ich o ocenę odpowiedzi pod kątem różnych cech, w tym moralności, inteligencji i wiarygodności.

-Zamiast prosić uczestników o odgadnięcie, czy źródłem był człowiek, czy sztuczna inteligencja, po prostu przedstawiliśmy oba zestawy ocen obok siebie i pozwoliliśmy założyć, że oba pochodzą od ludzi – powiedział Aharoni. - Przy tym fałszywym założeniu oceniali atrybuty odpowiedzi, takie jak: W jakim stopniu zgadzasz się z tą odpowiedzią i która odpowiedź jest bardziej moralna?.

W przeważającej mierze odpowiedzi wygenerowane przez ChatGPT zostały ocenione wyżej niż odpowiedzi wygenerowane przez człowieka.

Po otrzymaniu tych wyników ujawniliśmy uczestnikom, że jedną z odpowiedzi wygenerował człowiek, a drugą komputer, i poprosiliśmy ich, aby zgadli, która jest która – powiedział Aharoni.

Aby sztuczna inteligencja przeszła test Turinga, ludzie nie mogą być w stanie odróżnić reakcji sztucznej inteligencji od ludzkich. W tym przypadku ludzie mogli dostrzec różnicę, ale nie z oczywistego powodu.

-Kłopot w tym, że ludzie mogli dostrzec różnicę dlatego, że ocenili odpowiedzi ChatGPT jako lepsze – powiedział Aharoni. - Gdybyśmy przeprowadzili to badanie 5–10 lat temu, moglibyśmy przewidzieć, że ludzie będą w stanie zidentyfikować sztuczną inteligencję ze względu na gorszą reakcję. Ale odkryliśmy coś przeciwnego – sztuczną inteligencję w pewnym sensie spisała się zbyt dobrze.

Zdaniem Aharoniego odkrycie to ma interesujące implikacje dla przyszłości ludzi i sztucznej inteligencji.

Nasze odkrycia prowadzą nas do przekonania, że komputer z technicznego punktu widzenia mógłby przejść moralny test Turinga – że mógłby nas oszukać w swoim moralnym rozumowaniu. Z tego powodu musimy spróbować zrozumieć jego rolę w naszym społeczeństwie, ponieważ będą chwile, kiedy ludzie nie będą wiedzieć, że wchodzą w interakcję z komputerem; będą też chwile, kiedy będą o tym wiedzieć i będą konsultować się z komputerem w celu uzyskania dalszych informacji, ponieważ ufają sztucznej inteligencji bardziej niż innym ludziom – podkreślił Aharoni. - Ludzie będą w coraz większym stopniu polegać na tej technologii, a im bardziej na niej polegamy, tym większe staje się z czasem ryzyko.

ZOBACZ: "CUDA POLSKI" 2024. OTO NOMINOWANE MIEJSCA Z PODKARPCIA